Tras abordar la agenda en 2020 con la publicación de un “Libro Blanco sobre la Inteligencia Artificial”, el Consejo de Europa busca darse en las próximas semanas un marco regulatorio basado en la comprensión política de la conjunción de una alta potencialidad y un alto riesgo de este tipo de desarrollos tecnológicos ¿Cuáles son los ribetes que la institucionalidad política europea identifica como relevantes y cuáles los aprendizajes que podemos adoptar desde la Argentina para instalar este debate en la agenda pública?

La inteligencia artificial (AI, en lo sucesivo) ya está entre nosotros. No solo cuando recibimos una sugerencia de contenidos culturales basada en elecciones anteriores por parte de una plataforma digital, sino también, por ejemplo, en asesoramientos sobre cuestiones climatológicas en el sector agrícola, o a través de respuestas a consultas básicas desde el portal web o el servicio de mensajería instantánea de alguna empresa.

Atendiendo el trascendente impacto económico que puede tener su aplicación en una multiplicidad de sectores –se calcula que en 2025 las inversiones en IA, actualmente en torno a los 6.000 millones de euros, se multiplicarían por nueve–, crecen en los ámbitos académico, político y social las reflexiones en torno a la necesidad de generar un marco ético que permita una regulación sensata. La maduración de dichos procesos seguramente lleve más tiempo a la Humanidad que la implementación de la tecnología. En este sentido, el Consejo de Europa ha tomado la decisión de avanzar en una política regulatoria que puede ser cuestionada por extralimitada por algunos actores. En nuestra opinión, se inscribe en una tendencia a sobrerregular con la percepción de que siempre es más fácil modificar en un sentido habilitatorio posteriormente, cuando las experiencias y apropiaciones sociales de la discusión técnica estén más avanzadas. Por eso, resulta relevante dar a conocer algunos detalles de este proceso, a la luz de las necesidades regionales y nacionales en el terreno de la soberanía tecnológica.

Hay al menos tres grandes características de la IA que requieren ser consideradas a la hora de administrar su uso en la perspectiva del bien público: en primer lugar, comprender que, por la centralidad ideológica del positivismo, lo que se entiende por “inteligencia” en el contexto de esta discusión está homologado básicamente a la capacidad de cálculo racional, dejando afuera otros tipos de inteligencia. Extremar esta perspectiva nos lleva, como ya es evidente, a una depredación del entorno natural y sus recursos, así como del bienestar social, que está en creciente revisión. Por otro lado, se debe comprender que el gesto primigenio de la aplicación de un sistema de IA siempre responde a una decisión humana, y –en consecuencia– a determinados intereses que condicionan usos singulares en desmedro de otros. Esto, como se ha dicho, genera un desafío filosófico que requiere la elaboración de una ética aplicada.

Se calcula que en 2025 las inversiones en IA, actualmente en torno a los 6.000 millones de euros, se multiplicarían por nueve

En la Argentina, el Estado Nacional, por lo pronto –a través del Ministerio de Ciencia y Tecnología–viene desarrollando una agenda de trabajo desde hace ya algunos meses, buscando fortalecer el perfil argentino en esta agenda que, junto a Brasil, lidera a nivel regional.

El esfuerzo regulador europeo

En términos de desarrollo de la IA, la Unión Europea es un actor secundario en un tablero que lideran, cuando no, EEUU y China. Luego de publicar algunos lineamientos generales en 2020 a través del Libro blanco sobre IA, centrado en los valores de excelencia y confianza -que llama a construir una estrategia de retención del capital humano – y tras la decisión del Parlamento Europeo en octubre del año pasado de avanzar en este sentido, el Consejo de Europa avanza actualmente hacia un marco regulatorio. Su orientación es materia de debate público, especialmente tras la reciente filtración de un borrador confeccionado a inicios de año que sería próximamente tratado.

El borrador intenta evitar “riesgos inaceptables” en términos de derechos humanos fundamentales y protección de la seguridad tanto humana como de datos personales. Identifica dos ámbitos generales donde desplegar estas prevenciones: el primero hace al sector público y engloba, desde la identificación biométrica en el espacio público, hasta la operación de diversas infraestructuras esenciales. El segundo atañe al sector privado, con especial atención a la agenda sanitaria, la empleabilidad, el cálculo de riesgo crediticio, entre otras. En general, se orienta a restringir incrementalmente al sector privado, reservando por cuestiones de seguridad nacional algunas capacidades tecnológicas para el sector público.

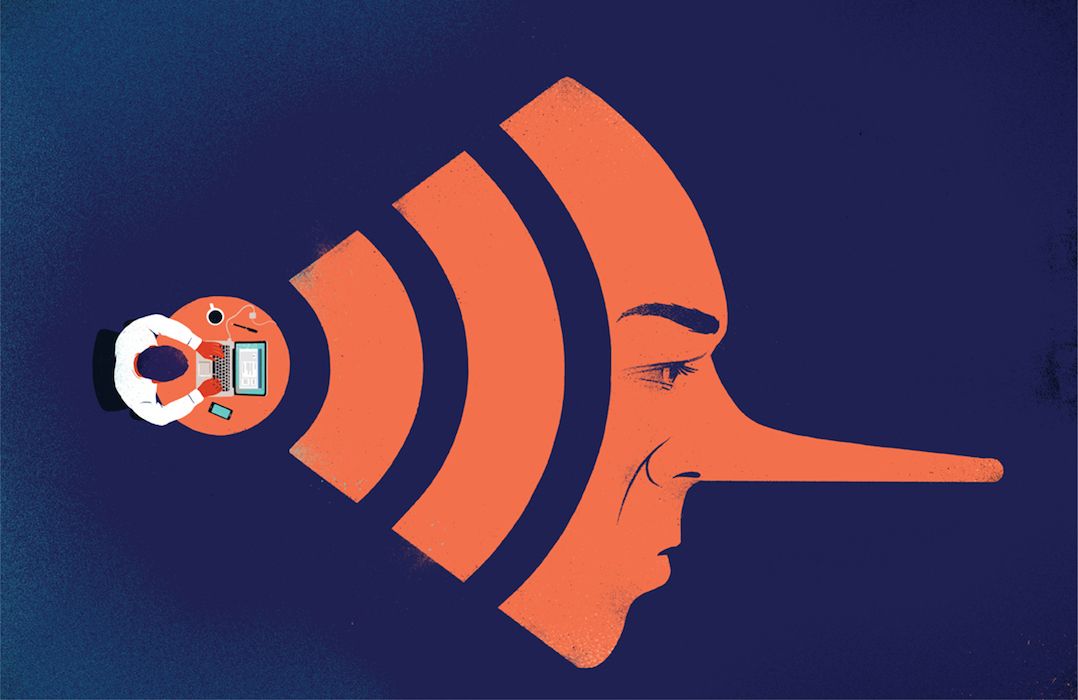

Algunas versiones indican que –complementariamente al marco regulatorio– se identificará una serie de prácticas prohibidas por infringir los “valores de la Unión Europea”. Estas incluirían la generación de sistemas de vigilancia institucionalizada, como el “Sistema de crédito social” chino, un mecanismo de castigo social que evalúa, entre otras cosas, el buen comportamiento digital de los ciudadanos (una suerte de Veraz público omnipresente). Como autoridad de aplicación se crearía un Consejo Europeo de Inteligencia Artificial, compuesto por un representante de cada Estado miembro y uno por la propia Comisión Europea, cuya misión será emitir recomendaciones y opiniones relevantes, con foco en la lista de prácticas prohibidas y la de sistemas de alto riesgo. Las multas previstas pueden llegar al 4% de la facturación anual, con topes en torno a los 20 millones de euros.

Como no podía ser de otra manera, existen críticas a la orientación que el proceso europeo está tomando. Entre ellas, podemos nombrar los cuestionamientos ante la ausencia de criterios de distinción entre el aprendizaje automático orgánico (un sistema informático “librado” a aprender autómatamente) y los sistemas basados en reglas, o la ausencia de una propuesta sobre cómo discriminar externamente si las decisiones son tomadas por humanos o por máquinas. Otros detractores cuestionan que, tras una retórica de promover el potencial de la AI, la primera reacción institucional sea regularla. Otro de los grandes debates es la forma en la que la dominación basada en la racialización o la inequidad de género se expresa a través de la IA, cuyos sistemas se representan desde la perspectiva de varones blancos adultos.

Algunas versiones indican que –complementariamente al marco regulatorio– se identificará una serie de prácticas prohibidas por infringir los “valores de la Unión Europea”. Estas incluirían la generación de sistemas de vigilancia institucionalizada, como el “Sistema de crédito social” chino, un mecanismo de castigo social que evalúa, entre otras cosas, el buen comportamiento digital de los ciudadanos (una suerte de Veraz público omnipresente)

Son observaciones que parecieran pertinentes y que debemos reintroducir en la matriz de reflexión colectiva que este tipo de desafíos requiere. Agregamos a éstas el hecho de que el reglamento excluiría “los sistemas de inteligencia artificial utilizados exclusivamente para la operación de armas u otros fines militares”, lo que seguramente traiga acalorados debates. Más allá de esto, Europa está dando un paso adelante en una materia que puede resultar –por el peso de su bloque en el terreno geopolítico–, relevante. Y países como España han sancionado estrategias nacionales en relación a la cuestión. Suramérica, más allá de las limitaciones de sus órganos de integración y coordinación regional, debe darse también –a nuestro entender– una política en este sentido.

¿Logrará la Unión Europea darse una política que equilibre el desarrollo productivo de la IA y un abordaje ético que limite sus riesgos? ¿Cuánto de esta experiencia podrá servir para otros territorios y contextos geoculturales? Indudablemente con la aceleración de la curva tecnológica tendremos que acostumbrarnos a darnos más, mejores y más veloces debates sobre la apropiación social de los nuevos desarrollos. Esta experiencia puede servir como un laboratorio para trazar aprendizajes e identificar con mayor claridad los nuevos desafíos.

- Europa busca regular la Inteligencia Artificial - 15 abril, 2021